前言

本篇文章开始介绍Spark基础知识,包括Spark诞生的背景,应用环境以及入门案例等,还是Spark学习之旅前,得先安装Spark环境才行,具体安装步骤可以看Spark环境搭建,让我们接着往下聊。

一、Spark概述

(一)Spark是什么

Spark是Apache顶级的开源项目,主要用于处理大规模数据的分析引擎,该引擎的核心数据结构是RDD弹性分布式数据集,这是一种分布式内存抽象,程序员可以使用RDD在大规模集群中做内存运算,并具有一定的容错方式;

Spark保留了MapReduce的分布式并行计算的优点,还改进了其较为明显的缺陷,中间数据存储在内存中,大大提高了运行速度,同时还提供了丰富的API,提高了开发速度。

(二)Spark的四大特点

Spark底层使用Scala语言,是一种面向对象、函数式编程语言,能够像操作本地集合一样轻松的操作分布式数据集,Spark具有运行速度快、易用性好、通用性强和随处运行等特点;

(1)速度快,Spark支持内存计算,并且通过DAG有向无环图执行引擎支持无环数据流,相对MapReduce来说,Spark处理数据时,可以将中间处理结果数据存储到内存中,Spark每个任务以线程方式执行,并不是像MapReduce以进程方式执行,线程的启动和销毁相对于进程来说比较快;

(2)易于使用,Spark 支持Java、Scala、Python 、R和SQL语言等多种语言;

(3)通用型强,Spark 还提供包括Spark SQL、Spark Streaming、MLib 及GraphX在内的多个工具库,可以在同一个应用中无缝地使用这些工具库;

(4)运行方式多,Spark 支持多种运行方式,包括在 Hadoop 和 Mesos 上,也支持 Standalone的独立运行模式,同时也可以运行在云Kubernetes上,获取数据的方式也很多,支持从HDFS、HBase、Cassandra 及 Kafka 等多种途径获取数据。

(三)Spark的风雨十年

Spark的发展主要经历过几大阶段:

(1)2009年Spark起源于加州伯克利分校;

(2)2013年被捐赠给Apache;

(3)2014年称为Apache顶级项目;

(4)2016年Spark2.0发布

(5)2019年Spark3.0发布

(四)Spark框架模块

整个Spark 框架模块包含:Spark Core、 Spark SQL、 Spark Streaming、 Spark GraphX和 Spark MLlib,大部分模块的能力都在建立在其核心引擎之上;

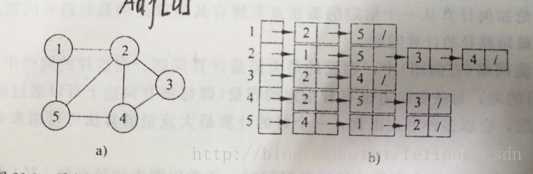

(1)Spark Core,该模块的数据结构是RDD,实现了Spark的基本功能,包括RDD、任务调度、内存管理、错误恢复以及与存储系统交互等;

(2)Spark SQL,该模块的数据结构主要是DataFrame,是Spark用来操作结构化数据的程序包,通过该模块,可以直接使用SQL操作数据;

(3)Spark Streaming,其主要的数据结构是DStream离散化流,是Spark对实时数据进行流式计算的组件;

(4)Spark GraphX,该模块的数据结构为RDD或者DataFrame,是Spark中用于图计算的组件,性能良好,拥有丰富的功能和运算符,能在海量数据上自如地运行复杂的图算法;

(5)Spark MLlib,该模块的数据结构也是RDD或者DataFrame,主要用于机器学习,提供了常见的机器学习功能的程序库,包括分类、回归、聚类等,同时也支持模型评估和数据导入等功能。

(五)Spark通信框架

整个Spark 框架通信模块为Netty,Spark 1.6版本引入了Netty,在Spark 2.0之后,完全使用Netty,并移除了akka。

总结

Spark保留了MapReduce的分布式计算,基于内存计算,提高的数据的计算能力;

其主要模块有Spark Core、 Spark SQL、 Spark Streaming、 Spark GraphX和 Spark MLlib,不仅可以通过SQL的方式操作数据,还可以对实时数据进行流式计算,同时也支持机器学习;

Spark的特点主要是计算速度快,支持多种编程语言,并且提供了众多友好的API,使得Spark的学习成本大大降低了。

以上就是大数据之Spark基础环境的详细内容,更多关于Spark基础环境的资料请关注好代码网其它相关文章!